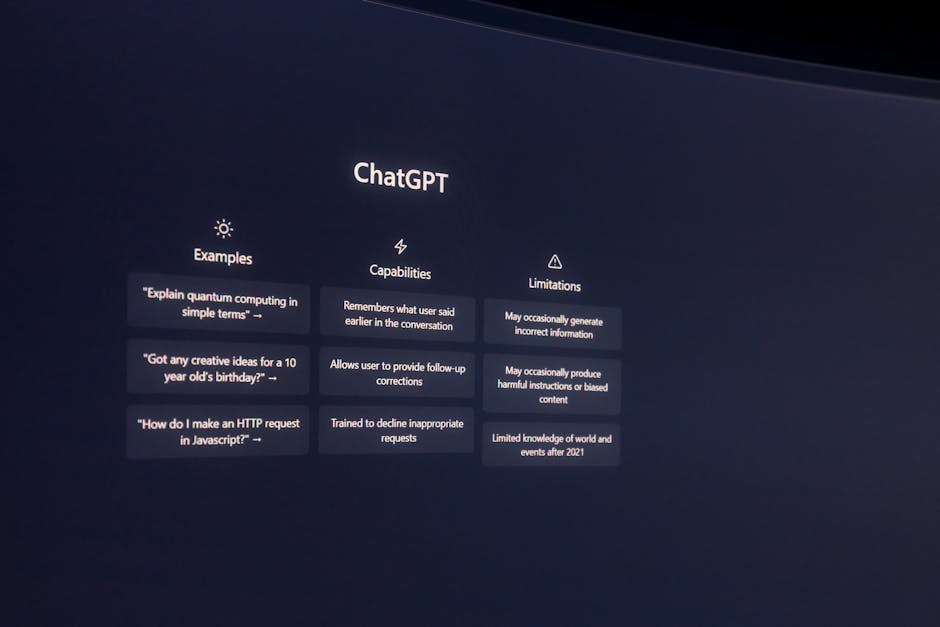

Le autorità di controllo, tra cui il Garante italiano, hanno lanciato un allarme sull’uso improprio delle tecnologie di generazione automatica di contenuti, specialmente coinvolgendo minori. Questo avviene in un contesto in cui sistemi di intelligenza artificiale possono creare immagini o video realistici senza consenso, portando a rischi elevati di violazione della privacy e altri danni. È importante comprendere come l’uso responsabile e regolamentato possa tutelare i soggetti più vulnerabili nelle nostre società digitali.

Rischi e responsabilità legati alle tecnologie di generazione automatica di contenuti

Le immagini intime generate dall’intelligenza artificiale rappresentano uno dei rischi più gravi e attuali collegati alle tecnologie di generazione automatica di contenuti. Questi sistemi, sfruttando algoritmi avanzati di deep learning, sono in grado di creare immagini realistiche e convincere spesso anche gli esperti, rendendo difficile distinguere tra contenuti autentici e fake. Il problema si acuisce quando tali immagini vengono utilizzate per scopi dannosi, come il ricatto, la diffamazione o la diffusione di materiale sessualmente esplicito senza il consenso delle persone coinvolte. La preoccupazione aumenta nel caso in cui le immagini vengano attribuite a minori, aumentando il rischio di abuso e di violazione della privacy, oltre a porre seri problemi etici e legali. Le autorità di controllo, tra cui il Garante italiano, hanno evidenziato l’urgenza di regolare e monitorare l’uso di queste tecnologie per proteggere i soggetti più vulnerabili e prevenire scenari di manipolazione o abuso. È fondamentale che le piattaforme digitali adottino misure di sicurezza efficaci e che siano sviluppate norme più stringenti per contrastare queste forme di violazione, garantendo così un uso più sicuro e responsabile dell’intelligenza artificiale nel campo della generazione di contenuti visivi.

Implicazioni legali e responsabilità delle imprese

Inoltre, le imprese devono essere particolarmente attente alla creazione, distribuzione e manipolazione di immagini intime generate dall’intelligenza artificiale, dato l’allarme lanciato dai Garanti per la protezione dei dati e per la tutela dei minorenni. Questi strumenti digitali, se usati in modo improprio, possono portare a gravi conseguenze legali, tra cui sanzioni amministrative e penali, oltre a danni reputazionali irreparabili. Le aziende sono chiamate a implementare procedure di verifica e controllo per evitare che sistemi di intelligenza artificiale vengano utilizzati per creare contenuti illeciti o dannosi, specialmente quando coinvolgono minorenni o soggetti vulnerabili. La responsabilità si estende anche alla formazione del personale, affinché riconosca i rischi e agisca prontamente in caso di comportamenti sospetti o violazioni. In ambito giuridico, esistono normative che puniscono la distribuzione di contenuti non consensuali o dannosi, obbligando le imprese a prendere misure efficaci per bloccare tali fenomeni. È quindi fondamentale che le aziende adottino un approccio proattivo e trasparente, garantendo non solo la conformità alle leggi vigenti, ma anche la tutela dei diritti fondamentali di tutte le persone coinvolte, con particolare riguardo ai minori. Questo richiede l’implementazione di tecnologie di controllo, politiche di responsabile gestione dei dati e una comunicazione chiara e aperta con gli utenti e le autorità competenti.

Innovazione e regolamentazione

Nel contesto dell’innovazione tecnologica legata alle immagini intime generate dall’intelligenza artificiale, i Garanti per la protezione dei dati e i relativi enti di controllo hanno lanciato un forte allarme circa i potenziali rischi per la salute e la sicurezza, specialmente dei minori. La creazione di contenuti realisticamente falsi può portare a conseguenze dannose, come il cyberbullismo, la diffusione di materiale non consensuale e possibili tentativi di adescamento.“ Per contrastare questi rischi, le autorità stanno valutando l’introduzione di normative specifiche che regolamentino l’uso di tecnologie di intelligenza artificiale e la produzione di immagini sensibili, anche mediante l’adozione di sistemi di sorveglianza e verifiche automatizzate sui contenuti pubblicati online. Simultaneamente, si riconosce l’importanza di un’applicazione equilibrata delle regole: da un lato, si favorisce l’innovazione e lo sviluppo di nuove piattaforme che sfruttano l’intelligenza artificiale, dall’altro si garantisce che tali innovazioni non vengano utilizzate per arrecare danno agli utenti, in particolare ai più giovani. La collaborazione tra autorità di controllo, sviluppatori e aziende è fondamentale per creare un ecosistema digitale sicuro, nel quale i progressi tecnologici siano accompagnati da misure efficaci di tutela, sensibilizzando pubblicamente sui rischi e promuovendo pratiche etiche e responsabili nell’utilizzo delle tecnologie avanzate.

Linee guida per le aziende

Le aziende devono inoltre implementare procedure di controllo interno e formare il personale sulla corretta gestione delle tecnologie di intelligenza artificiale, con particolare attenzione alla tutela dei minori e alla prevenzione di contenuti inappropriati. È fondamentale sviluppare politiche chiare e condivise che regolamentino la produzione, distribuzione e conservazione di immagini generate dall’IA, assicurando il rispetto delle normative sulla privacy e sulla tutela dei diritti individuali. La sensibilizzazione e l’educazione degli utenti rappresentano un’altra componente essenziale per contrastare l’utilizzo improprio di questi strumenti, contribuendo a creare un ambiente digitale più sicuro e responsabile per tutti.

Focus sui rischi per i minori

Nel contesto dei minori, la gestione dei rischi è prioritaria. Le tecnologie devono essere progettate considerando specifiche misure di tutela, come filtri e controlli avanzati, per proteggere i più giovani da contenuti potenzialmente dannosi, sfruttamenti o manipolazioni.

SCADENZA: 31/12/2024

DESTINATARI: sviluppatori, piattaforme online, aziende tech, autorità di controllo

MODALITÀ: collaborazione e implementazione di strumenti di tutela

COSTO: gratuito, in accordo con normative e linee guida

FAQs

Immagini intime generate dall’intelligenza artificiale: l’allarme dei Garanti, attenzione ai minori — approfondimento e guida

È la creazione artificiale di immagini intime realistiche senza consenso, con rischi di abuso, manipolazione e violazione della privacy, specialmente dei minori.

Rischi di ricatto, diffamazione, diffusione di contenuti non consensuali, abuso di minori e violazioni della privacy, con potenziali conseguenze legali e sociali.

Implementare sistemi di controllo, filtri avanzati, verifiche automatiche dei contenuti e normative più stringenti per prevenire abusi e utilizzo illecito.

Devono adottare procedure di verifica, formazione del personale, rispettare normative sulla privacy e bloccare contenuti non autorizzati o dannosi, con particolare attenzione ai minori.

Le normative mirano a vietare contenuti non consensuali, imporre controlli e sanzioni, e promuovere un uso etico e sicuro dell’IA, specialmente con focus sui minorenni.

Attraverso normative, sistemi di sorveglianza, verifiche automatizzate e collaborazioni con sviluppatori e piattaforme online, per monitorare e bloccare contenuti illeciti o dannosi.

Applicare filtri avanzati, controlli automatizzati, educare genitori e bambini, e sviluppare piattaforme sicure che rispettino le normative di tutela.

Le principali sfide riguardano la manipolazione della realtà, il rispetto della privacy, il rischio di abuso e la protezione dei soggetti vulnerabili, specialmente i minorenni.