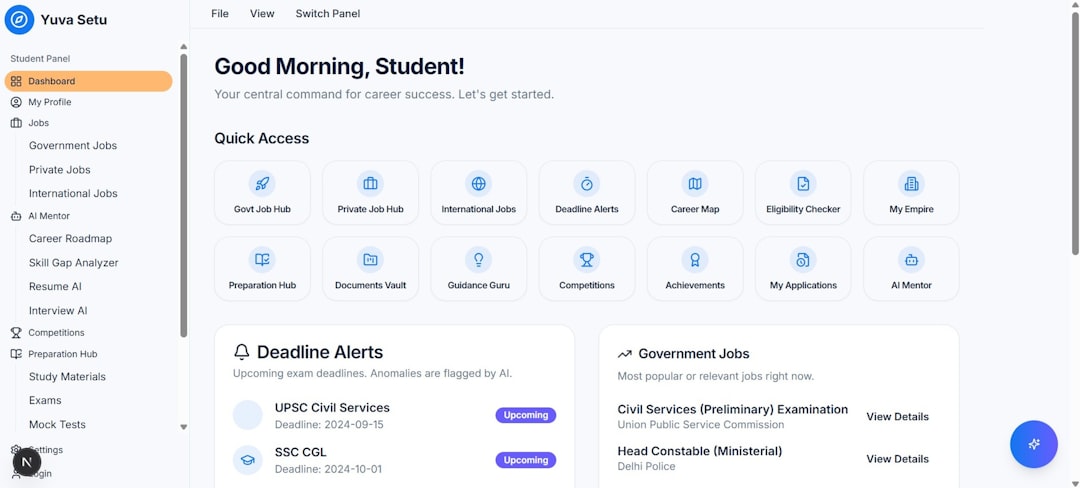

Il Parlamento europeo ha rivisto l’AI Act all’interno del pacchetto digital omnibus, optando per una timeline più realistica. L’obiettivo è bilanciare innovazione e tutele sociali senza gravare sulle imprese. Le nuove regole introducono obblighi per l’IA ad alto rischio dal 2 dicembre 2027, estensioni per i sistemi soggetti a norme di sicurezza di prodotto dal 2 agosto 2028, e misure di tracciabilità come la watermarking entro 2 novembre 2026. Inoltre, si rafforza il coordinamento tra IA e normative settoriali e si prevede il divieto dei Nudifier, salvo salvaguardie efficaci dimostrate dai fornitori.

Obblighi chiave e date: cosa cambia per imprese, scuole e utenti

| Ambito | Obblighi principali | Entrata in vigore | Note |

|---|---|---|---|

| IA ad alto rischio | Valutazione dei rischi, trasparenza, registri di conformità, audit | 2 dicembre 2027 | Obblighi fondamentali per applicazioni ad alto rischio |

| Sistemi regolati da norme di sicurezza di prodotto | Conformità, gestione dei rischi, incident reporting | 2 agosto 2028 | Integrazione con normative di prodotto esistenti (dispositivi medici, apparecchiature, giocattoli) |

| Etichettatura contenuti IA | Watermarking o marcatura digitale dei contenuti generati o modificati | 2 novembre 2026 | Obbligo per fornitori; distinguere contenuti sintetici |

| Nudifier | Divieto esplicito di strumenti che generano contenuti sessuali non consensuali; eccezioni solo con salvaguardie efficaci | N/D | Escalation normativa su salvaguardie; definizioni in corso |

| Coordinamento normativo | Applicazione meno stringente quando esistono normative di sicurezza settoriali | N/A | Riduce duplicazioni e oneri amministrativi |

Quadro operativo e contesto di applicazione

La riforma propone un equilibrio tra efficacia della regolamentazione e fiducia nell’innovazione. L’assenza di standard tecnici armonizzati ha spinto al rinvio di alcune scadenze, ma si continua a lavorare su standard comuni per evitare disparità tra Stati membri. Il coordinamento con normative settoriali è progettato per evitare duplicazioni e facilitare l’approccio alle tecnologie di IA in settori complessi come sanità, industria e media.

Il pacchetto mira anche a una maggiore prevedibilità: gli strumenti di IA e i fornitori dovranno adattarsi a regole chiare su contenuti generati e sull’integrità delle fonti, preservando diritti e privacy. In sintesi, una cornice comune che facilita l’innovazione responsabile senza rinunciare al controllo pubblico.

Azioni pratiche per conformarsi alle nuove regole IA

Per le scuole e le aziende, l’aggiornamento inizia con una mappatura dell’uso dell’IA e la distinzione tra contesti ad alto rischio e attività ordinarie. Valuta quali strumenti generano contenuti, come vengono trattati i dati e se coinvolgono minori o immagini di persone. Identifica scenari potenziali di rischio e verifica che esistano misure di sicurezza dai fornitori.

Definisci ruoli e responsabilità, crea processi di conformità e programma una formazione mirata. Aggiorna policy di privacy e sicurezza, e integra una checklist di adempimenti operativi. Includi procedure di watermarking e controlli di consenso per contenuti generati dall’IA.

- Auditare uso IA per mappare gli utilizzi e identificare aree a rischio.

- Definire ruoli responsabilità per governance interna e gestione delle non conformità.

- Stabilire processi di conformità e audit interni.

- Richiedere fornitori certificati e contratti con clausole di sicurezza.

- Programmare formazione docenti e staff su IA, privacy e sicurezza.

FAQs

Stop ai deepfake sessuali, scadenze rinviate: l’Unione Europea riscrive le regole sull’intelligenza artificiale

Divieto esplicito di strumenti che generano contenuti sessuali non consensuali; le salvaguardie efficaci devono essere dimostrate dai fornitori. L’obiettivo è proteggere le persone pur mantenendo spazio all’innovazione.

Entrata in vigore IA ad alto rischio: 02/12/2027. Sistemi regolati da norme di sicurezza di prodotto: 02/08/2028. Etichettatura contenuti IA (watermarking): 02/11/2026. Coordinamento normativo e riduzione duplicazioni previste.

Il coordinamento prevede un’applicazione meno stringente quando esistono normative di sicurezza settoriali, con l’obiettivo di ridurre duplicazioni e oneri amministrativi per imprese e enti.

Inizia con la mappatura dell’uso dell’IA e la distinzione tra contesti ad alto rischio e attività ordinarie. Definisci ruoli e responsabilità, aggiorna policy di privacy e sicurezza, programma formazione e integra watermarking e controlli di consenso per contenuti generati dall’IA.