Il Parlamento Europeo annuncia una dilazione delle norme sull’AI ad alto rischio e sull’istruzione, con l’entrata in vigore prevista per 2 dicembre 2027 per i sistemi elencati e 2 agosto 2028 per i software di sicurezza integrati. Questo cambia le priorità di docenti, ATA, dirigenti e referenti IT, offrendo azioni pratiche da inserire subito in agenda. Questo quadro mira a fornire strumenti concreti a presidi, segreterie e laboratori per una transizione rapida ma sicura.

Tabella delle scadenze

Con riferimento alla Tabella delle scadenze, si evidenzia che l’orizzonte normativo relativo all’Intelligenza Artificiale: slitta al 2027 l’applicazione delle regole del Parlamento Europeo per quella ad alto rischio e per l’istruzione. Questo rinvio risponde alle esigenze di coordinamento tra istituzioni europee e Stati membri, nonché alla necessità di definire strumenti di supervisione, misurazione dei rischi e strumenti educativi adeguati. La presente estensione della tabella mira a fornire una descrizione chiara delle principali fasi, delle azioni richieste e delle parti coinvolte, in modo che studenti, professionisti e responsabili di enti pubblici possano comprendere cosa cambierà e quali passi seguire nei prossimi anni.

- Scadenza / Fase: Transizione normativa 2024-2025; Azione Richiesta: finalizzare emendamenti, definire cornice applicativa e strumenti di conformità; Chi è coinvolto: Parlamento Europeo, Commissione, Consiglio, autorità di regolazione nazionali, stakeholder.

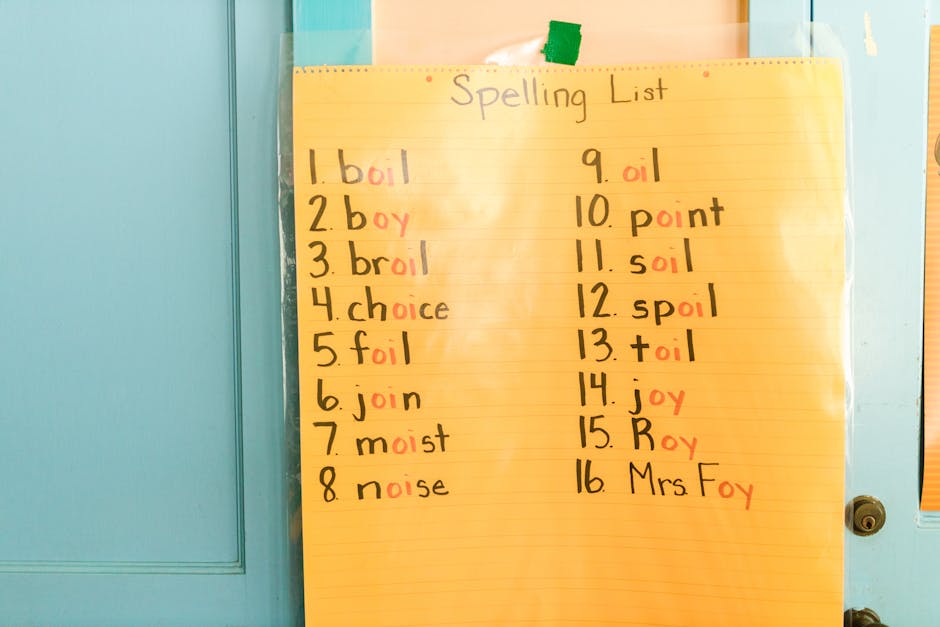

- Scadenza / Fase: Educazione e istruzione; Azione Richiesta: allineare i piani di studio, fornire linee guida per docenti e infrastrutture digitali nelle scuole; Chi è coinvolto: Ministeri dell’istruzione, agenzie UE, scuole, fornitori di tecnologia educativa, organismi di valutazione.

- Scadenza / Fase: Regole per l’AI ad alto rischio; Azione Richiesta: definire requisiti di vigilanza, registri di auditing e obblighi di trasparenza; Chi è coinvolto: imprese tecnologiche interessate, autorità di vigilanza, organismi notificanti, autorità nazionali per la protezione dei dati.

- Scadenza / Fase: Conformità delle aziende tecnologiche; Azione Richiesta: introdurre pacchetti di conformità graduali, scadenze differenziate e strumenti di verifica; Chi è coinvolto: imprese, associazioni di categoria, ispettori, audit partner.

- Scadenza / Fase: Infrastrutture e supporto alla transizione; Azione Richiesta: garantire investimenti in infrastrutture digitali, formazione del personale e supporto alle PMI; Chi è coinvolto: Commissione, Stati membri, enti pubblici locali, associazioni imprenditoriali.

- Scadenza / Fase: Monitoraggio e revisione; Azione Richiesta: definire KPI, meccanismi di reporting e revisioni legislative periodiche; Chi è coinvolto: Commissione europea, Parlamento, comitati di regolamentazione, autorità di vigilanza.

In sintesi, la programmazione futura prevede un percorso di adeguamento normativo e operativo che giungerà a piena applicazione nel 2027, con fasi di consultazione, implementazione e verifica. L’obiettivo è garantire un equilibrio tra innovazione, sicurezza e istruzione, assicurando che le regole sull’Intelligenza Artificiale siano efficaci, trasparenti e pratiche da adottare per enti pubblici, scuole e aziende.

Impatto pratico per docenti e ATA

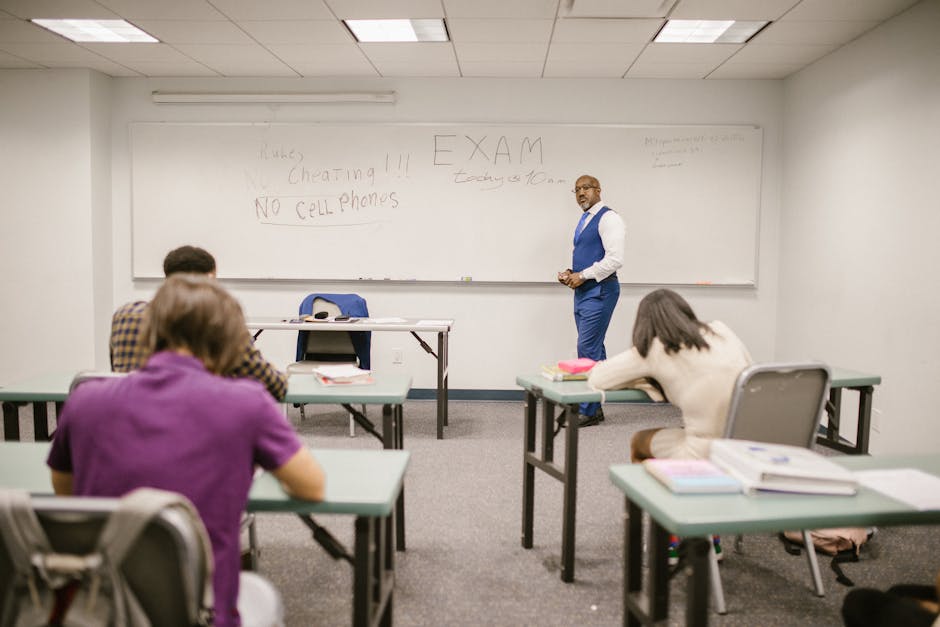

Contesto operativo e quadro normativo L’introduzione dell’Intelligenza Artificiale: slitta al 2027 l’applicazione delle regole del Parlamento Europeo per quella ad alto rischio e per l’istruzione. In pratica, le scuole devono agire ora con azioni concrete, definendo responsabilità, processi e strumenti per garantire sicurezza, efficacia e trasparenza nell’uso delle IA.

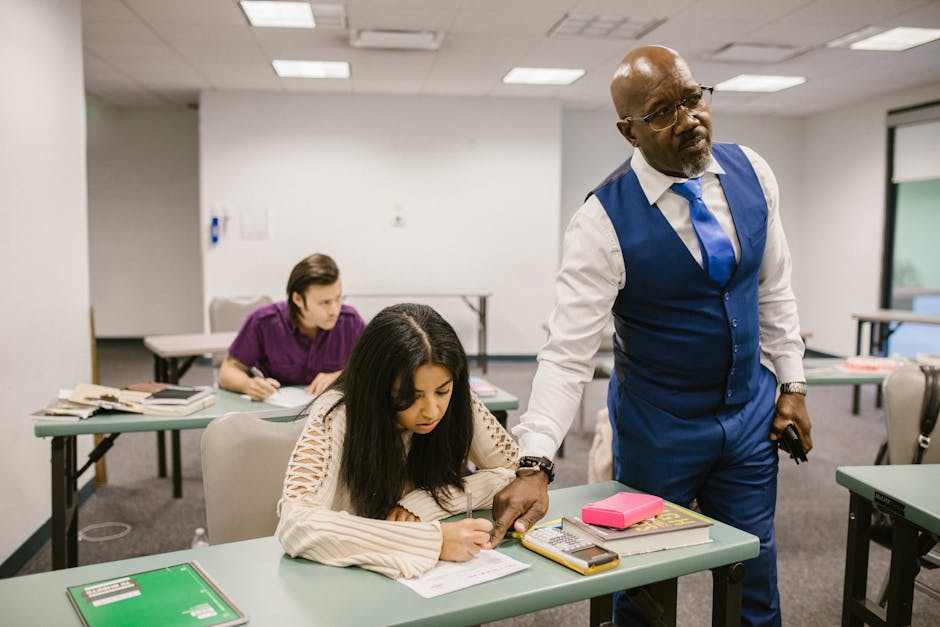

La dilazione non deve tradursi in inerzia. Docenti e ATA hanno il compito di aggiornare strumenti didattici e gestionali, di coordinarsi con i referenti IT e didattici per mappare gli strumenti IA in uso e di prevedere misure di controllo per evitare duplicazioni o ritardi. Questo richiede un dialogo costante tra presidenza, segreteria e servizi ICT, nonché una pianificazione delle risorse e dei tempi. In parallelo, è necessario definire una cornice operativa che renda rapido l’adeguamento delle pratiche interne alle evoluzioni normative.

Per rendere operativo l’indirizzo, è utile definire una serie di azioni pratiche e misurabili:

- Identificare IA ad alto rischio in uso in classe e nei processi amministrativi.

- Verificare le misure di sicurezza e di consenso per contenuti generati da IA.

- Predisporre una guida interna aggiornata sulle regole di utilizzo.

- Monitorare l’uso di IA e definire KPI di efficacia e di percorso.

- Definire canali di controllo e KPI di efficacia per le IA adottate.

- Avviare una mappatura completa degli strumenti IA, includendo fornitori, versioni, dati trattati, responsabilità.

- Impostare un Piano di gestione del rischio che classifichi le applicazioni in alto, medio e basso rischio, con azioni di mitigazione.

- Assicurare che i dati degli studenti siano protetti: consenso, minimizzazione, tracciabilità, e rispetto delle norme sulla privacy.

- Predisporre un calendario di formazione continua per docenti e ATA su etica, sicurezza, uso didattico e gestione dei dati.

- Definire procedure chiare per incidenti IA, con incarico di riferimento, tempi di risposta e reportistica.

- Stabilire una guida operativa interna e un sistema di aggiornamento periodico delle politiche per accompagnare la transizione, anche in vista dell’entrata a regime delle norme europee nel 2027.

- Costruire un registro degli strumenti IA in uso e un piano di gestione delle licenze, per evitare duplicazioni e garantire la tracciabilità.

In parallelo, è utile istituire una struttura di governance interna che faciliti la coerenza tra docenti, ATA e IT, con revisioni periodiche delle pratiche e aggiornamenti delle linee guida. Una speciale attenzione va dedicata alla trasparenza delle operazioni IA, all’informazione rivolta a studenti e genitori e alla responsabilizzazione degli utenti, in modo che l’uso delle tecnologie resti orientato agli obiettivi educativi e alla tutela della privacy. Infine, è consigliabile predisporre strumenti di documentazione come una checklist di conformità, un modello DPIA per i progetti IA e una procedura di reportistica per eventuali anomalie, sempre nel rispetto della dilazione normativa e delle risorse disponibili.

Azioni immediate entro breve

Azioni immediate entro 2 settimane: mappare i sistemi IA, designare responsabili, documentare i rischi. Coinvolgimento di dirigente scolastico, responsabile digitale e referenti di laboratorio per definire chi fa cosa. Stabilire scadenze interne e canali di reporting per evitare ritardi. Stabilire meccanismi di audit settimanali e di aggiornamento delle liste IA.

- Comunicare agli staff le nuove scadenze e responsabilità.

- Formare personale su requisiti di sicurezza e privacy.

- Verificare la conformità delle soluzioni IA esistenti.

- Stabilire criteri di controllo e monitoraggio periodico delle soluzioni in uso.

Prossimi passi e filigrana

Filigrana digitale: la scadenza è spostata al 2 novembre 2026 per i contenuti creati artificialmente. La plenaria esaminerà il pacchetto con voto previsto per 26 marzo, per avviare le negoziazioni definitive con il Consiglio.

Dal punto di vista amministrativo, piccole e medie imprese avranno tutele e strumenti di accompagnamento per non rallentare l’innovazione. Le scuole dovranno monitorare l’evoluzione normativa e aggiornare procedure entro ogni nuova tornata legislativa. Queste misure permetteranno una verifica continua e una gestione pragmatica dei rischi legati all’IA nelle scuole.

FAQs

Intelligenza Artificiale: nuove tempistiche UE per AI ad alto rischio e istruzione slittano al 2027

Entrata in vigore prevista: 02/12/2027 per i sistemi elencati e 02/08/2028 per i software di sicurezza integrati. La dilazione mira a coordinare istituzioni europee e Stati membri, definendo strumenti di supervisione e conformità.

Identificare IA ad alto rischio in uso e verificare misure di sicurezza e consenso; predisporre una guida interna aggiornata; monitorare l’uso con KPI e definire canali di controllo. Avviare la mappatura degli strumenti IA e definire un Piano di gestione del rischio, con attenzione a privacy, formazione e aggiornamenti periodici.

La tabella delle scadenze prevede KPI, meccanismi di reporting e revisioni legislative periodiche; la vigilanza coinvolge la Commissione europea, il Parlamento e comitati di regolamentazione, nonché autorità di vigilanza.

Entro 2 settimane: mappare i sistemi IA, designare responsabili, documentare i rischi; coinvolgere dirigente, responsabile digitale e referenti di laboratorio per definire chi fa cosa. Stabilire scadenze interne e canali di reporting, avviare audit settimanali e aggiornare le liste IA.